Problema: Dados 2 processos i e j, você precisa escrever um programa que possa garantir a exclusão mútua entre os dois sem qualquer suporte de hardware adicional.

Desperdício de ciclos de clock da CPU

Em termos leigos, quando um thread estava aguardando sua vez, ele terminava em um longo loop while que testava a condição milhões de vezes por segundo, fazendo cálculos desnecessários. Existe uma maneira melhor de esperar e é conhecida como 'colheita' .

Para entender o que ele faz, precisamos nos aprofundar em como o agendador de processos funciona no Linux. A ideia mencionada aqui é uma versão simplificada do agendador e a implementação real apresenta muitas complicações.

Considere o seguinte exemplo

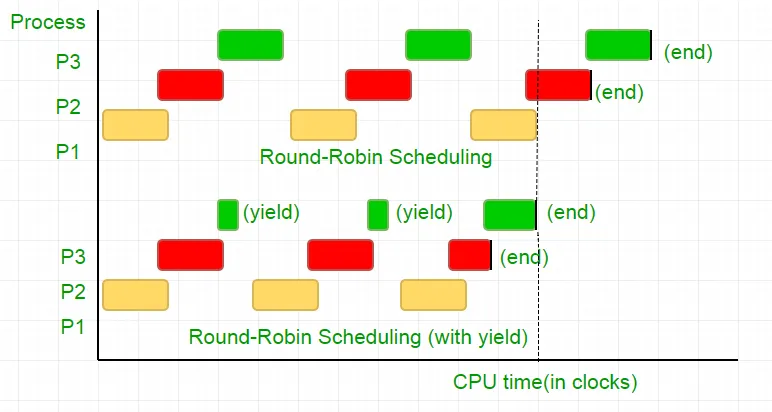

Existem três processos P1 P2 e P3. O processo P3 é tal que possui um loop while semelhante ao do nosso código, realizando cálculos não tão úteis e existe no loop somente quando P2 termina sua execução. O agendador coloca todos eles em uma fila round robin. Agora digamos que a velocidade do clock do processador seja 1.000.000/seg e ele aloque 100 clocks para cada processo em cada iteração. Então primeiro P1 será executado por 100 relógios (0,0001 segundos) depois P2 (0,0001 segundos) seguido por P3 (0,0001 segundos) agora, como não há mais processos, este ciclo se repete até que P2 termine e então seguido pela execução de P3 e eventualmente seu encerramento.

Isso é um desperdício completo dos 100 ciclos de clock da CPU. Para evitar isso, desistimos mutuamente do intervalo de tempo da CPU, ou seja, do rendimento que essencialmente encerra esse intervalo de tempo e o escalonador escolhe o próximo processo a ser executado. Agora testamos nossa condição uma vez e depois desistimos da CPU. Considerando que nosso teste leva 25 ciclos de clock, economizamos 75% de nossa computação em um intervalo de tempo. Para colocar isso graficamente

Considerando a velocidade do clock do processador como 1 MHz, isso representa uma grande economia!

Distribuições diferentes fornecem funções diferentes para alcançar essa funcionalidade. Linux fornece sched_yield() .

void lock(int self) { flag[self] = 1; turn = 1-self; while (flag[1-self] == 1 && turn == 1-self) // Only change is the addition of // sched_yield() call sched_yield(); }

Cerca de memória.

O código do tutorial anterior pode ter funcionado na maioria dos sistemas, mas não estava 100% correto. A lógica era perfeita, mas a maioria das CPUs modernas emprega otimizações de desempenho que podem resultar em execução fora de ordem. Essa reordenação das operações de memória (carregamentos e armazenamentos) normalmente passa despercebida em um único thread de execução, mas pode causar comportamento imprevisível em programas simultâneos.

Considere este exemplo

while (f == 0); // Memory fence required here print x;

No exemplo acima, o compilador considera as 2 instruções independentes uma da outra e, portanto, tenta aumentar a eficiência do código reordenando-as, o que pode levar a problemas para programas simultâneos. Para evitar isso, colocamos uma barreira de memória para dar dicas ao compilador sobre o possível relacionamento entre as instruções através da barreira.

Então a ordem das declarações

sinalizador[self] = 1;

turn = 1-self;

while (virar verificação de condição)

colheita();

tem que ser exatamente o mesmo para que o bloqueio funcione, caso contrário, ele terminará em uma condição de deadlock.

Para garantir isso, os compiladores fornecem instruções que evitam a ordenação de instruções através dessa barreira. No caso do gcc é __sync_synchronize() .

Então o código modificado se torna

Implementação completa em C:

// Filename: peterson_yieldlock_memoryfence.cpp // Use below command to compile: // g++ -pthread peterson_yieldlock_memoryfence.cpp -o peterson_yieldlock_memoryfence #include

// Filename: peterson_yieldlock_memoryfence.c // Use below command to compile: // gcc -pthread peterson_yieldlock_memoryfence.c -o peterson_yieldlock_memoryfence #include

import java.util.concurrent.atomic.AtomicInteger; public class PetersonYieldLockMemoryFence { static AtomicInteger[] flag = new AtomicInteger[2]; static AtomicInteger turn = new AtomicInteger(); static final int MAX = 1000000000; static int ans = 0; static void lockInit() { flag[0] = new AtomicInteger(); flag[1] = new AtomicInteger(); flag[0].set(0); flag[1].set(0); turn.set(0); } static void lock(int self) { flag[self].set(1); turn.set(1 - self); // Memory fence to prevent the reordering of instructions beyond this barrier. // In Java volatile variables provide this guarantee implicitly. // No direct equivalent to atomic_thread_fence is needed. while (flag[1 - self].get() == 1 && turn.get() == 1 - self) Thread.yield(); } static void unlock(int self) { flag[self].set(0); } static void func(int s) { int i = 0; int self = s; System.out.println('Thread Entered: ' + self); lock(self); // Critical section (Only one thread can enter here at a time) for (i = 0; i < MAX; i++) ans++; unlock(self); } public static void main(String[] args) { // Initialize the lock lockInit(); // Create two threads (both run func) Thread t1 = new Thread(() -> func(0)); Thread t2 = new Thread(() -> func(1)); // Start the threads t1.start(); t2.start(); try { // Wait for the threads to end. t1.join(); t2.join(); } catch (InterruptedException e) { e.printStackTrace(); } System.out.println('Actual Count: ' + ans + ' | Expected Count: ' + MAX * 2); } }

import threading flag = [0 0] turn = 0 MAX = 10**9 ans = 0 def lock_init(): # This function initializes the lock by resetting the flags and turn. global flag turn flag = [0 0] turn = 0 def lock(self): # This function is executed before entering the critical section. It sets the flag for the current thread and gives the turn to the other thread. global flag turn flag[self] = 1 turn = 1 - self while flag[1-self] == 1 and turn == 1-self: pass def unlock(self): # This function is executed after leaving the critical section. It resets the flag for the current thread. global flag flag[self] = 0 def func(s): # This function is executed by each thread. It locks the critical section increments the shared variable and then unlocks the critical section. global ans self = s print(f'Thread Entered: {self}') lock(self) for _ in range(MAX): ans += 1 unlock(self) def main(): # This is the main function where the threads are created and started. lock_init() t1 = threading.Thread(target=func args=(0)) t2 = threading.Thread(target=func args=(1)) t1.start() t2.start() t1.join() t2.join() print(f'Actual Count: {ans} | Expected Count: {MAX*2}') if __name__ == '__main__': main()

class PetersonYieldLockMemoryFence { static flag = [0 0]; static turn = 0; static MAX = 1000000000; static ans = 0; // Function to acquire the lock static async lock(self) { PetersonYieldLockMemoryFence.flag[self] = 1; PetersonYieldLockMemoryFence.turn = 1 - self; // Asynchronous loop with a small delay to yield while (PetersonYieldLockMemoryFence.flag[1 - self] == 1 && PetersonYieldLockMemoryFence.turn == 1 - self) { await new Promise(resolve => setTimeout(resolve 0)); } } // Function to release the lock static unlock(self) { PetersonYieldLockMemoryFence.flag[self] = 0; } // Function representing the critical section static func(s) { let i = 0; let self = s; console.log('Thread Entered: ' + self); // Lock the critical section PetersonYieldLockMemoryFence.lock(self).then(() => { // Critical section (Only one thread can enter here at a time) for (i = 0; i < PetersonYieldLockMemoryFence.MAX; i++) { PetersonYieldLockMemoryFence.ans++; } // Release the lock PetersonYieldLockMemoryFence.unlock(self); }); } // Main function static main() { // Create two threads (both run func) const t1 = new Thread(() => PetersonYieldLockMemoryFence.func(0)); const t2 = new Thread(() => PetersonYieldLockMemoryFence.func(1)); // Start the threads t1.start(); t2.start(); // Wait for the threads to end. setTimeout(() => { console.log('Actual Count: ' + PetersonYieldLockMemoryFence.ans + ' | Expected Count: ' + PetersonYieldLockMemoryFence.MAX * 2); } 1000); // Delay for a while to ensure threads finish } } // Define a simple Thread class for simulation class Thread { constructor(func) { this.func = func; } start() { this.func(); } } // Run the main function PetersonYieldLockMemoryFence.main();

// mythread.h (A wrapper header file with assert statements) #ifndef __MYTHREADS_h__ #define __MYTHREADS_h__ #include

// mythread.h (A wrapper header file with assert // statements) #ifndef __MYTHREADS_h__ #define __MYTHREADS_h__ #include

import threading import ctypes # Function to lock a thread lock def Thread_lock(lock): lock.acquire() # Acquire the lock # No need for assert in Python acquire will raise an exception if it fails # Function to unlock a thread lock def Thread_unlock(lock): lock.release() # Release the lock # No need for assert in Python release will raise an exception if it fails # Function to create a thread def Thread_create(target args=()): thread = threading.Thread(target=target args=args) thread.start() # Start the thread # No need for assert in Python thread.start() will raise an exception if it fails # Function to join a thread def Thread_join(thread): thread.join() # Wait for the thread to finish # No need for assert in Python thread.join() will raise an exception if it fails

Saída:

Thread Entered: 1

Thread Entered: 0

Actual Count: 2000000000 | Expected Count: 2000000000